La Doppia Elica della Collaborazione AI: Perché i Team Enterprise Hanno Bisogno di Più del Human-in-the-Loop

La Doppia Elica della Collaborazione AI: Perché i Team Enterprise Hanno Bisogno di Più del Human-in-the-Loop

TL;DR

La collaborazione AI enterprise non è una singola linea tra un umano e un agente. Nella pratica, emergono tre livelli: umano-agente (le fondamenta), umano-umano (review, autorità, contesto organizzativo) e agente-agente (orchestrazione specializzata su scala). Noi la chiamiamo doppia elica: due filamenti di collaborazione che corrono in parallelo, connessi da punti di giunzione umano-agente. La maggior parte delle piattaforme ottimizza i punti di giunzione ignorando i filamenti. Ed è lì che le implementazioni enterprise falliscono silenziosamente.

Perché il "human-in-the-loop" da solo non basta

Tutti disegnano la stessa immagine quando parlano di collaborazione con l'AI. Un umano da un lato, un agente AI dall'altro, una linea che li collega. Human-in-the-loop. Semplice, pulito, intuitivo.

E incompleto, almeno per come funzionano realmente i team di sviluppo software enterprise.

Dopo mesi di lavoro con i nostri primi clienti enterprise sulla piattaforma FairMind, abbiamo osservato qualcosa che nessuno dei framework esistenti riesce a catturare:

- La relazione umano-agente è reale e fondamentale, ma è solo il punto di partenza

- Quando entra in un'organizzazione reale, attiva inevitabilmente due ulteriori livelli di collaborazione

- La maggior parte delle piattaforme ignora completamente questi livelli

Noi la chiamiamo la doppia elica della collaborazione AI. E se state costruendo o adottando piattaforme AI per team enterprise, comprenderla cambia tutto nel modo in cui progettate il vostro prodotto e i vostri flussi di lavoro.

Le fondamenta: la collaborazione umano-agente

Partiamo da ciò che l'industria comprende bene. La collaborazione diretta tra un umano e un agente AI è il mattone essenziale:

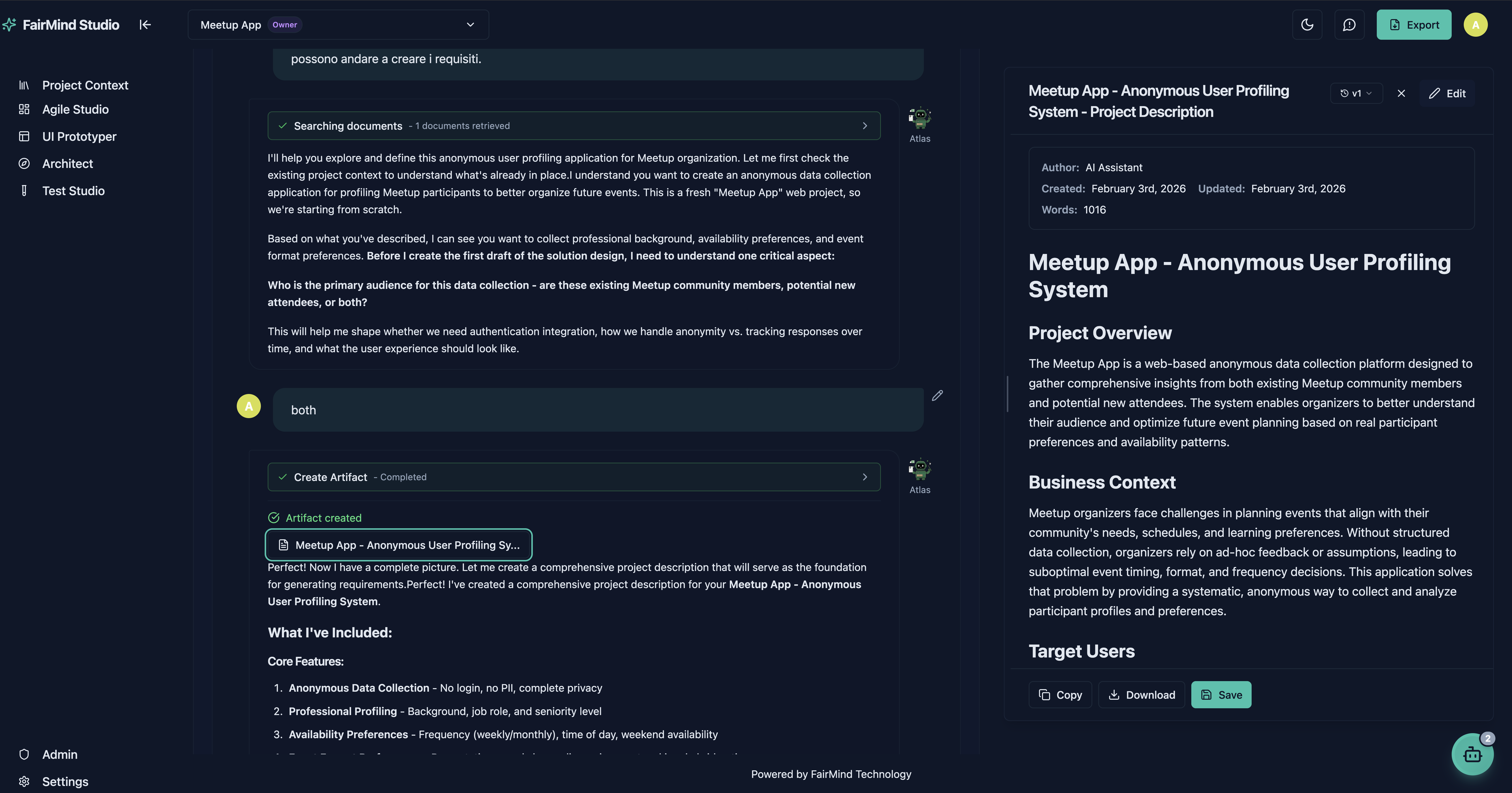

- Uno sviluppatore che lavora con un agente AI per produrre un solution design

- Un architetto che usa un agente per analizzare opzioni infrastrutturali

- Un tech lead che sfrutta un agente per generare strategie di test

Questo livello è ben compreso, ampiamente studiato e al centro di praticamente ogni piattaforma AI sul mercato. In FairMind, è dove i nostri agenti specializzati (NOVA per il solution design, SAGE per la code review, ATLAS per l'analisi architetturale e altri) incontrano gli umani che lavorano con loro quotidianamente.

Ma il punto è questo: nello sviluppo software enterprise, queste fondamenta sono necessarie ma insufficienti. Perché nel momento in cui un umano riceve l'output di un agente, accadono due cose che il modello human-in-the-loop non contempla.

Cosa abbiamo osservato sul campo

Ecco un pattern che abbiamo visto ripetutamente con i nostri clienti:

- ATLAS produce un solution design tecnico dettagliato per uno sviluppatore del team

- Lo sviluppatore lo esamina, il livello umano-agente che funziona esattamente come progettato

- Ma il documento tocca decisioni architetturali che richiedono il contributo di un collega senior

Così lo sviluppatore condivide il deliverable con quel collega. Ne discutono. Mettono in discussione le assunzioni. Aggiungono contesto organizzativo che nessun agente AI avrebbe potuto conoscere: vincoli politici, peculiarità dei sistemi legacy, migrazioni in corso, capacità del team.

Questo è il primo livello emergente: la collaborazione umano-umano, attivata dall'interazione originale umano-agente.

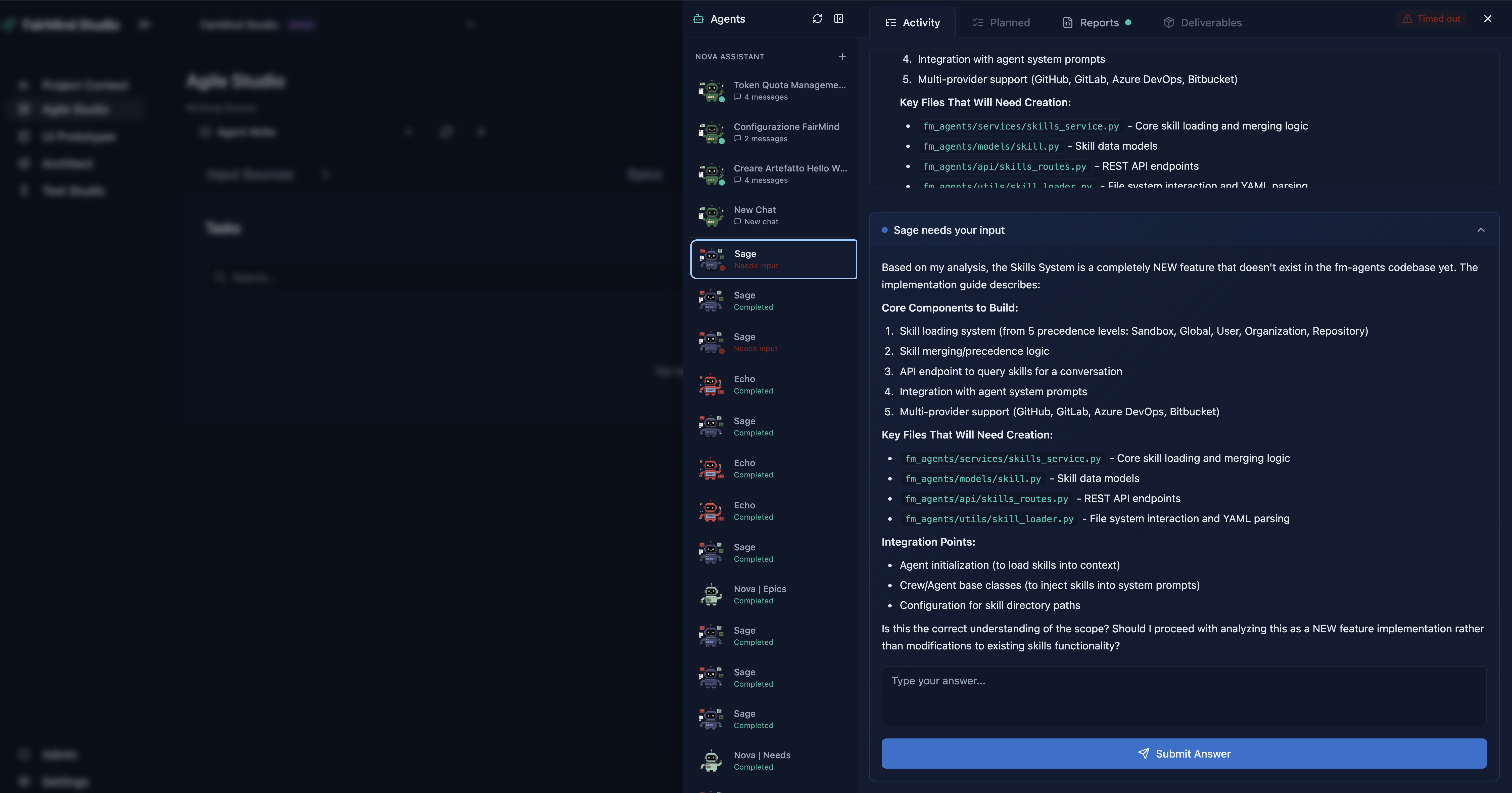

Poi il feedback deve tornare all'agente, non come un generico "riprova", ma come input strutturato e contestualizzato che permetta all'agente di produrre una seconda iterazione significativamente migliore. E a volte, il collega senior invoca un agente diverso (magari uno specializzato in security review o pianificazione infrastrutturale) per validare un aspetto specifico.

Questo è il secondo livello emergente: la collaborazione agente-agente, innescata dalla decisione umana di portare ulteriori capacità specializzate nel flusso di lavoro.

Quello che era iniziato come una singola linea tra un umano e un agente è diventato una doppia elica.

Tre livelli, una struttura

Siamo precisi su ciò che stiamo descrivendo.

Livello 1: Umano-Agente (le fondamenta)

L'interazione diretta in cui umani e agenti AI lavorano insieme su compiti specifici. Ogni piattaforma AI si concentra qui. È necessario, ben compreso e funziona.

Livello 2: Umano-Umano (review e autorità)

Dove avvengono review, validazione e decisioni organizzative. È dove risiede l'autorità, dove la conoscenza istituzionale entra nel processo, dove si esercita la responsabilità. Segue le dinamiche sociali e gerarchiche dell'organizzazione e opera a un ritmo deliberato perché coinvolge giudizio, negoziazione e fiducia.

Livello 3: Agente-Agente (orchestrazione su scala)

Dove agenti AI specializzati scompongono problemi, delegano sotto-task, condividono contesto e producono artefatti. Segue la logica di orchestrazione tecnica e opera velocemente, spesso in modo asincrono, e a una scala che sarebbe impossibile per i soli umani.

L'insight critico: il secondo e il terzo livello non sono estensioni opzionali. Emergono inevitabilmente nel momento in cui si distribuiscono agenti AI in un'organizzazione reale con team reali. Hanno velocità diverse, modelli di governance diversi, modalità di fallimento diverse e dinamiche di fiducia diverse.

Eppure quasi ogni framework nel panorama attuale, da ChatCollab a MetaGPT ad AutoGen, tratta tutti i partecipanti, umani o AI, come nodi in un'unica struttura di collaborazione piatta. Il gap tra la letteratura accademica sui sistemi multi-agente e quella sul teaming umano-AI è precisamente dove vive la realtà enterprise.

La doppia elica: una metafora strutturale

In biologia molecolare, il DNA consiste di due filamenti che corrono in parallelo, collegati a intervalli regolari da coppie di basi. Nessun filamento funziona da solo. L'informazione che codifica la vita emerge dalla loro interazione complementare.

Nel nostro modello:

- I due filamenti = livello di collaborazione umano-umano + livello di collaborazione agente-agente

- Le coppie di basi = interazioni umano-agente (i punti di giunzione dove l'informazione attraversa da un filamento all'altro)

- Il filamento umano porta conoscenza organizzativa, autorità, giudizio e responsabilità

- Il filamento agente porta potenza computazionale, consistenza, specializzazione e velocità

L'industria ha speso anni a ottimizzare le coppie di basi (rendendo l'interazione umano-agente più fluida, più naturale, più produttiva) ignorando in gran parte i filamenti che connettono. Ma coppie di basi senza filamenti sono solo legami chimici isolati. Sono i filamenti a dare loro struttura, direzione e significato.

I punti di giunzione: dove il valore si crea o si distrugge

I momenti più consequenziali avvengono dove un deliverable attraversa da un filamento all'altro:

Agente → Filamento umano

L'output necessita di traduzione contestuale. Gli umani che lo revisionano devono capire non solo cosa ha prodotto l'agente, ma perché ha fatto certe scelte, quali alternative ha considerato, su quali assunzioni si è basato. Senza questo, la revisione umana diventa o un timbro automatico (troppa fiducia) o un frustrante interrogatorio a scatola chiusa (troppo poca fiducia).

Umano → Filamento agente

Il feedback necessita di struttura. Una conversazione tra due ingegneri può produrre un insieme ricco e sfumato di insight, ma un agente AI non può agire su "ne abbiamo parlato e pensiamo che l'approccio dovrebbe essere diverso". Il feedback deve essere scomposto in parametri specifici e azionabili.

Questi punti di giunzione sono dove la maggior parte delle implementazioni AI enterprise fallisce silenziosamente. Non perché gli agenti sono scarsi, e non perché gli umani sono resistenti, ma perché nessuno ha progettato il passaggio di consegne.

Cosa significa per il design delle piattaforme

Una volta che si vede la struttura completa, diverse implicazioni di design diventano chiare.

1. Funzionalità di collaborazione per gli umani, non solo interfacce U-A

La maggior parte delle piattaforme AI tratta l'umano come un operatore isolato. Ma se il passo successivo è condividere l'output con un collega, annotarlo, discuterlo e poi reindirizzare il feedback a un agente, la piattaforma deve supportare l'intero flusso. È per questo che in FairMind abbiamo rilasciato funzionalità di collaborazione umano-umano direttamente nella nostra piattaforma, così che review, validazione e decision-making non sfuggano verso email, Slack o conversazioni di corridoio dove il contesto si perde.

2. Protocolli di handoff espliciti a ogni punto di giunzione

Ogni volta che un deliverable attraversa da un filamento all'altro, il sistema dovrebbe catturare i metadati giusti: ragionamento dell'agente, vincoli applicati, livello di confidenza; e di ritorno, cosa hanno deciso gli umani e perché. In FairMind, i nostri agenti si fermano ai punti decisionali chiave e richiedono esplicitamente feedback umano prima di procedere. Quel feedback può arrivare minuti o ore dopo. L'agente aspetta, preservando il suo stato di ragionamento completo, e riprende con l'input arricchito. Oltre a questi checkpoint, gli umani possono anche co-editare gli artefatti dei nostri agenti: epic, user story, task, soluzioni architetturali e altro.

3. Visibilità della struttura completa

In qualsiasi punto, ogni partecipante dovrebbe vedere dove si trova nella doppia elica. Oggi su FairMind, gli utenti possono ispezionare l'intera catena di ragionamento di ogni agente e intervenire direttamente sulla memoria. Le nostre nuove funzionalità permettono a più umani di plasmare collaborativamente la memoria e il contesto di un singolo agente, così che l'intelligenza collettiva del filamento umano alimenti direttamente il filamento agente.

Guardando avanti

Le aziende che otterranno il massimo valore dagli agenti AI non saranno quelle con gli agenti individuali più intelligenti o le interfacce chat più fluide. Saranno quelle che progetteranno i loro flussi di lavoro attorno alla doppia elica: due filamenti di collaborazione che corrono in parallelo, connessi da punti di giunzione ben progettati, producendo risultati che nessun singolo livello potrebbe raggiungere da solo.

In FairMind, questo non è solo un framework concettuale. È la nostra product roadmap. Ci impegniamo a rendere i passaggi di consegne tra umano e agente, agente e umano, e agente e agente progressivamente più espliciti, tracciabili e governabili. E stiamo investendo fortemente nel rendere la collaborazione umano-umano sugli artefatti generati dagli agenti il più fluida possibile, perché questo è il filamento che il resto dell'industria sta trascurando.

Resta in Prima Linea.

Iscriviti alla newsletter di FairMind per approfondimenti esclusivi sullo sviluppo AI-powered, workflow agentici e casi d'uso MCP reali, una volta al mese nella tua inbox. Niente rumore, solo segnale. → Iscriviti ora

#AI #SoftwareDevelopment #Enterprise #CodeGeneration #DevOps #TechInnovation #SoftwareEngineering #AgileManagement #DigitalTransformation

Pronto a Trasformare il Tuo Sviluppo Software Enterprise?

Unisciti alle organizzazioni che utilizzano FairMind per rivoluzionare il proprio ciclo di vita del software: Build, manutenzione ed evoluzione.